Warum die Roboter dumm bleiben

Können Maschinen wie Googles Chatbot LaMDA Intelligenz entwickeln? Nicht, solange sie keinen Körper haben: Erst das In-der-Welt-sein macht klug.

Auf den Punkt gebracht

- Keine Seele. Ein Ingenieur bei Google wollte bei einem Chatbot Bewusstsein ausgemacht haben – er lag falsch.

- Dumme Maschinen. Eine Künstliche Intelligenz kann nur dann intelligent werden, wenn sie einen Körper hat, mit dem sie die Welt erfährt.

- Nur Fachidioten. Bislang erfüllen KIs nur den Zweck, für den sie erbaut wurden – ob Chatbot oder Saugroboter.

- Wie Kinder. Wollten wir intelligente Roboter, müssten wir sie wie Kinder erziehen und als Mitgeschöpfe betrachten, nicht als Sklaven.

Vor wenigen Monaten schockierte Google Ingenieur Blake Lemoine die Welt. Googles Chatbot LaMDA, so behauptete er, habe Bewusstsein und eine Seele. Auf Fragen, wie er das denn wissen könne antwortete er, dass LaMDA ihm das selbst gesagt hätte; LaMDAs Reflektionen seien von einer derartigen Tiefe gewesen, dass er dem Chatbot glauben müsse.

Lemoine wurde sofort von Google beurlaubt und später entlassen. Und Experten sind sich einig, dass LaMDA kein Bewusstsein hat. Aber wie konnte einem Ingenieur ein solcher Irrtum unterlaufen?

Mehr im Dossier Künstliche Intelligenz

- Hauke Behrendt zur Frage: Automatisieren wir unsere Jobs weg?

- Georg Dorffner analysiert, was es heißt, wenn Computer an Katzen scheitern

- Oliver Bendel beantwortet die Frage: Brauchen Computer eine Moral?

- Sepp Hochreiter über ein Missverständnis: Computer, löse unsere Probleme!

Gespräche wie mit einem Menschen

Chatbots wie LaMDA und OpenAIs GPT-3 sind faszinierende Technologien. Sie suchen das Internet nach Inhalten ab, die interessant sein könnten und können dann tiefe philosophische Gespräche führen. 1950 entwickelte Alan Turing, ein Pionier der KI, einen Intelligenztest für Computer: Eine Maschine sei intelligent, wenn ein Mensch in einer Unterhaltung mit der Maschine nicht erkennen könne, ob es sich um eine Maschine oder einen anderen Menschen handele.

Sowohl LaMDA als auch GPT-3 bestehen diesen Test heute. Unterhaltungen mit ihnen sind wie mit einem Menschen.

Jedoch kann das auch manipuliert werden. Ich könnte beide Chatbots mit wenigen Worten in Rassisten und Antisemiten verwandeln, denn diese Maschinen haben keine Filter. Jeder Gesprächsstoff, der im Netz zu finden ist, wird von ihnen als geeignet empfunden und so eben auch der Hass, der im Netz viel propagiert wird. Beide geben nur das wieder, was sie im Netz gelesen haben; sie generieren nicht von sich aus neue Ideen oder Gedanken. Das macht diese Maschinen letzthin recht dumm ...

Ohne Körper keine Gefühle

Ich glaube, dass Intelligenz verkörpert ist, und dass Maschinen wie LaMDA und GPT-3 deshalb eigentlich dumm sind, weil sie die Welt nie erfahren haben. Sie haben nie etwas gesehen oder gehört. Sie haben nie etwas berührt. Alle Sinneserfahrungen sind ihnen fremd. Jedoch ist es gerade dieses In-der-Welt-sein, dass unsere Intelligenz ausmacht. Babys lernen komplexe Konzepte wie zum Beispiel Objektkonsistenz (die Tatsache, dass ein Objekt sich selbst bleibt, auch wenn es aus dem Blickfeld des Beobachters zeitweise verschwindet) durch die Manipulation von Objekten. Wir werden uns unserer selbst bewusst, übrigens recht spät im Alter von zirka 40 Monaten, weil wir physisch lernen, dass andere Menschen andere Einheiten sind, die weniger kontrollierbar sind als der eigene Körper.

Halbleiter in der Krise

Wie schwer es den modernen Technologien fällt, sich in the physischen Welt zurechtzufinden, zeigen die Probleme mit dem autonomen Fahren. Und selbst die modernsten Roboter haben Schwierigkeiten, Butter aufs Brot zu schmieren. Wir finden das und ähnliche Fähigkeiten trivial, weil wir diese Tätigkeiten schon ausüben können, bevor wir volles Bewusstsein erlangt hatten. Aber wenn man die Schwierigkeiten sieht, die die moderne Technik mit diesen Dingen hat, merkt man schnell, wie komplex es eigentlich ist, sich in der Welt zu bewegen und mit ihr zu interagieren.

Intelligenz für einen Zweck

Das heisst, wenn wir wirkliche KI erschaffen möchten, muss diese verkörpert sein und die Möglichkeit haben, wie Kinder in die Welt hineingeführt zu werden, um schliesslich erwachsene Intelligenz zu erreichen.

Bisherige KIs sind Fachidioten. Sie erfüllen den einen Zweck, für den sie gebaut worden sind und nichts weiter. Wenn ein Roomba der nächsten Generationen sich eines Tages mit mir über Gedichte unterhalten will, sind wir einen großen Schritt weiter, aber bisher ist das noch längstens nicht der Fall. Nur wenn KI wie wir in der Welt „aufwächst“, wird sie diese generelle Intelligenz erlangen. Und leider gibt es seit dem 11. September 2001, an dem die USA angegriffen wurden und das World Trade Center zerstört wurde, kaum mehr Roboterprojekte, in denen dieses Aufwachsen simuliert wird, weil Geldgeber an kurzfristigen Erfolgen interessiert sind und nicht an solchen Langzeitprojekten.

Biohacking: Stark, schön, unsterblich?

Dennoch ist es spannend sich vorzustellen, wir hätten solche verkörperte KIs erbaut. Wenn das der Fall wäre, stellt sich die Frage, wie wir diese Geschöpfe behandeln würden. Zunächst einmal müssten wir in der Lage sein, sie wie Kinder zu behandeln, sodass sie auch so aufwachsen und lernen können. Das ist bereits eine große Herausforderung, denn leider sind wir Menschen notorisch dafür, dass wir unsere Mitgeschöpfe nicht gerade gut behandeln. Kinder werden aber gerade zu gesunden und intelligenten Erwachsenen, wenn wir sie lieben und ihnen das bestmögliche Lernumfeld gestalten.

Zahlen & Fakten

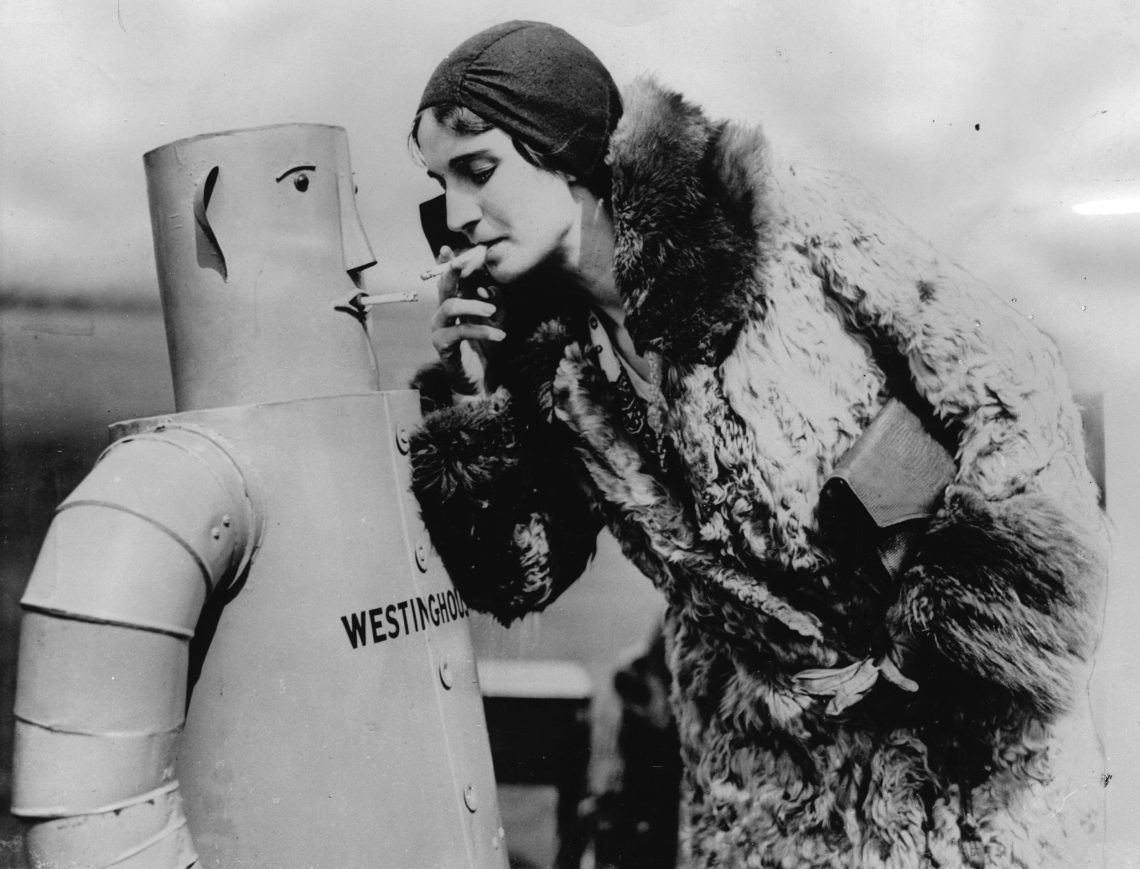

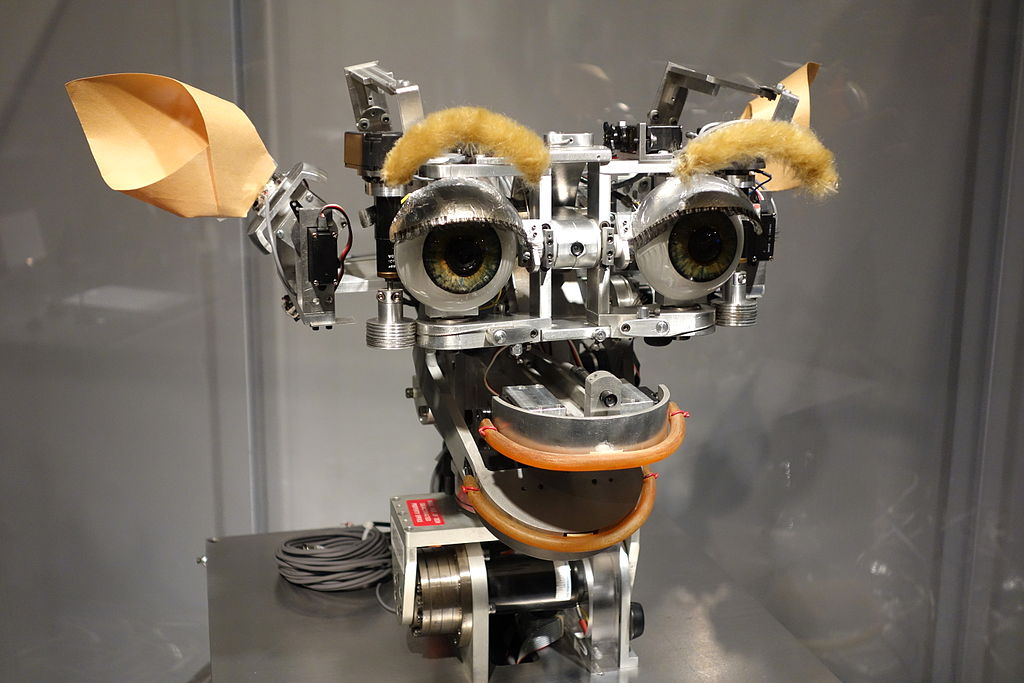

Kismet und Leonardo, Roboter mit Gefühl

Um die Jahrtausendwende wurde in Boston am Forschungsinstitut MIT an einer anderen Form von KI gearbeitet: Roboter, die wie Kinder lernen und Emotionen zeigen. An einem davon, Kismet, hat auch Anne Foerst als theologische Beraterin mitgearbeitet. Kismet – große Glubschaugen, roter Mund und rosa Schweineohren auf einem Gerüst aus Metall –, konnte nicht nur Emotionen mit den dazu passenden Gesichtsausdrücken darstellen. Er hat auch neue Emotionen und dazu passende Gesichtsausdrücke gelernt oder vielleicht sogar: empfunden.

Das Nachfolgemodell Leonardo – kleinere Augen, aber riesige, flauschige Ohren – meisterte zur Überraschung aller sogar den „Sally-und-Anne-Test“, ein Experiment aus der Entwicklungspsychologie. Ein Kind beobachtet zwei Puppen, Sally und Anne. Die Puppe Sally gibt eine Murmel in eine verschließbare Kiste und verlässt den Raum. Während ihrer Abwesenheit legt Anne die Murmel in eine andere Kiste. Nachdem Sally zurückgekehrt ist, wird das Kind gefragt: „Wo wird Sally das Spielzeug suchen?“ In Leonardos Fall fragt ein in den Raum zurückkommender Forscher, der Sallys Rolle innehat, zuerst: „Wo werde ich das Spielzeug suchen?“, und zur Kontrolle auch: „Wo ist das Spielzeug?“ Leonardo beantwortet beides richtig; sich normal entwickelnde Kinder bestehen diese Aufgabe meist erst mit vier Jahren. Sie erfordert die Fähigkeit, sich in ein Gegenüber hineinzuversetzen und zu verstehen, dass dieses Gegenüber ein anderes Wissen von der Welt hat.

Maschinen – Mitgeschöpfe der Zukunft?

Grundsätzlich ist das zunächst kein Problem, weil wir alles, was mit uns interagiert als menschlich behandeln, Wir anthropomorphisieren. Das ist auch der Grund, warum wir LaMDA und GPT-3 so viel zutrauen, obwohl beide Maschinen sehr begrenzt sind. Wir behandeln sie, als ob sie intelligent wären, projizieren auf sie. Auf diese Weise lernen sie und werden uns immer ähnlicher.

Aber auf der anderen Seite besteht zu befürchten, dass wir KIs aus unserer Gemeinschaft ausgrenzen aufgrund ihrer Andersartigkeit. Jedoch wage ich zu hoffen, dass wir solche KI gut behandeln würden, weil wir in ihnen uns selbst erkennen würden, da wir sie in unserem Ebenbild erschaffen haben. Letztlich muss sich unsere Gesellschaft daran messen lassen, wie wir diese zukünftigen KIs behandeln, ob als Sklaven oder aber als wertvolle Mitgeschöpfe.

Conclusio

Maschinen ein Bewusstsein zu unterstellen, ist falsch. Sie sind nicht einmal intelligent. Das liegt vor allem daran, dass ihnen ein Körper fehlt: Sie sehen nichts, sie hören nichts, sie berühren nichts. Aber leider hat die Forschung den Versuch aufgegeben, Roboter wie Kinder zu erziehen und sie so zu unseren Mitgeschöpfen zu machen. Deshalb werden Roboter auf absehbare Zeit auch dumm bleiben.

Mehr aus dem Dossier

Sind Maschinen das Ende der Menschheit?

Sie macht uns zu Sklaven der Maschinen, verdrängt uns vom Arbeitsmarkt, und irgendwann wird sie uns sowieso alle umbringen. Oder doch nicht? Ein Plädoyer für mehr Gelassenheit im Umgang mit künstlicher Intelligenz.