Warum die Kaffeetasse nicht schwebt

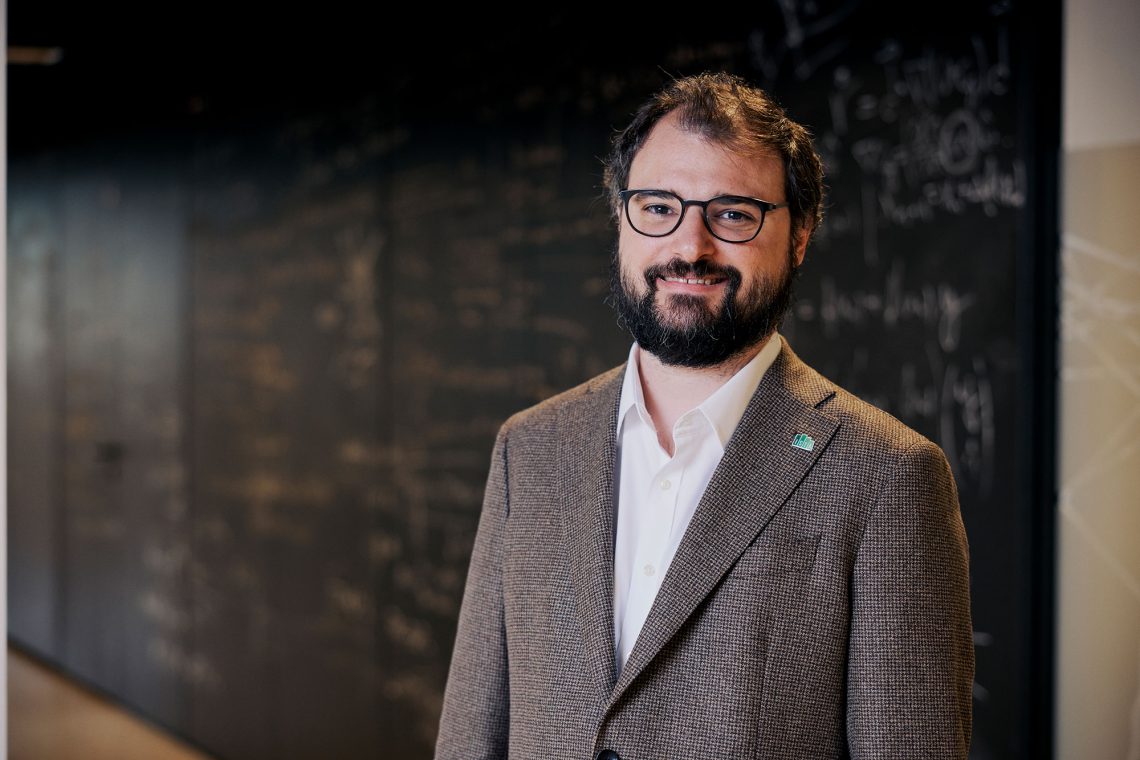

Künstliche Intelligenzen leisten beeindruckende Dinge. Aber schon mit simplen Kausalitäten haben sie Probleme. Francesco Locatello möchte das ändern.

Eine Tasse Kaffee steht auf einem Tisch. Jemand kommt und schiebt den Tisch drei Meter nach links. Wo ist die Tasse Kaffee?

Mehr Forschungsreisen

Keine Fangfrage, sie steht natürlich weiterhin auf dem Tisch, drei Meter weiter links, vielleicht ist etwas Kaffee verschüttet. Francesco Locatello hält seine Tasse Kaffee in der Hand, blickt sie an und fragt: „Warum bleibt sie nicht an ihrem Platz, warum schwebt sie nicht in der Luft?“ Nun ja, Schwerkraft zum Beispiel und verschiedene andere physikalische Gesetze, die wir vielleicht nicht benennen können, die uns aber nicht erstaunen.

Kausalität: Warum wir ins Krankenhaus gehen

Weil wir die Welt mit unseren Augen sehen, mit unserem Körper erfahren und deshalb Vorhersagen treffen können, wie sich Dinge verhalten. Wenn ich das mache, dann passiert das. Eine Künstliche Intelligenz kennt all das nicht, und genau das beschäftigt Locatello. Der gebürtige Italiener forscht seit 2023 am „Institute of Science and Technology Austria“ (ISTA) in Klosterneuburg an kausaler KI; zuvor war er an der ETH Zürich, bei Google und bei Amazon tätig. „Kausalität ist wichtig, weil KI immer mehr Teil unseres Alltags wird und es wichtig ist, dass sie versteht, dass nicht alle Korrelationen gleich sind.“

Also: Kranke Menschen gehen in ein Krankenhaus. Wir kennen die Kausalität: Sie gehen ins Krankenhaus, weil sie krank sind. Eine KI könnte zu einem anderen Schluss kommen: Menschen sind krank, weil sie ins Krankenhaus gehen. Sollen sie doch aufhören, das zu tun, dann sind sie nicht mehr krank. Problem gelöst.

Menschen sind schlechte Lehrer

Es ist sogar noch komplizierter, wenn man eine KI einfach nur mit Daten füttert. Sie könnte beispielsweise Bilder von Menschen analysieren, die in ein Krankenhaus gehen und zum Schluss kommen: Menschen, die Schuhe tragen, gehen in ein Krankenhaus. Wie lehrt man einer KI also Kausalität? Indem sie lernt wie wir, mehr oder weniger zumindest.

Ich weiß, wie man Auto fährt, aber ich wäre nicht in der Lage, ein simples Programm zu schreiben, das einer KI fahren lehrt.

Francesco Locatello

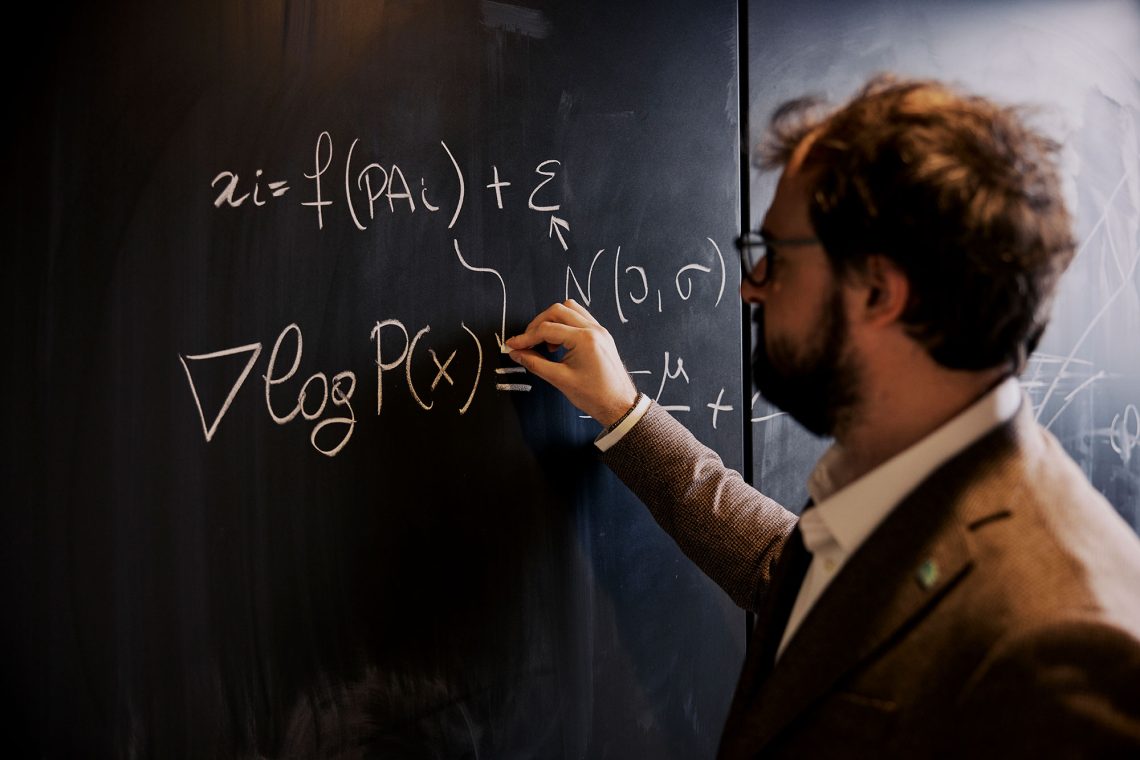

Dazu muss man wissen, dass wir Menschen nicht immer die besten Lehrer sind. Künstliche Intelligenz ist aus normalem Programmieren entstanden – jemand schreibt ein Programm, das dem Computer sagt, was er tun soll. „Es gibt aber viele Aufgaben, von denen wir zwar wissen, wie sie zu erledigen sind, die wir aber nicht besonders gut erklären können. Ich weiß zum Beispiel, wie man Auto fährt, aber ich wäre nicht in der Lage, ein simples Programm zu schreiben, das einer KI fahren lehrt“, erklärt Locatello. Deshalb sind Forscher dazu übergegangen, den KI-Modellen das Lernen selbst in die Hand zu geben. „Wir füttern sie mit Daten und sagen, was das gewünschte Ergebnis ist.“ So funktionieren – sehr grob gesagt – neuronale Netzwerke.

Damit diese neuronalen Netzwerke Kausalität verstehen, könnte man beispielsweise „eine Variable aktiv manipulieren, um die Effekte zu sehen“, sagt Locatello. Die KI würde in dem Fall also sehen, dass kranke Menschen auch dann noch ins Krankenhaus gehen, wenn man ihnen die Schuhe wegnimmt – weil es eben nicht die Schuhe sind, die sie ins Krankenhaus treiben.

Braucht Kausalität einen Körper?

Es gibt aber noch eine andere Möglichkeit: Die KI könnte ihre Umwelt selbst erfahren und daraus lernen, weil sie einen Körper hat. Die wissenschaftliche Community ist gespalten bei der Frage, ob eine KI, die sich ihren Namen wirklich verdienen will, zwingend einen Körper braucht. „Das ist eine faszinierende Frage“, sagt Locatello.

Eine definitive Antwort darauf hat er nicht, aber eine Tendenz. „Ich tippe aktuell darauf, dass es reicht, wenn eine KI etwas beobachtet.“ Wenn sie etwas sieht, aber nicht unbedingt einen Körper hat. „Allerdings braucht sie dann die Fähigkeit zu generalisieren. Was für die Tasse Kaffee gilt, gilt auch für das Handy, das ebenfalls am Tisch liegt“, erklärt Locatello. Sonst müsste die KI jede mögliche Handlung auf der Welt beobachten.

In seinem Büro hängen Bilder an der Wand, die nur auf den allerersten Blick wie abstrakte Malerei aussehen. Sie stammen von dem Künstler Tom White und zeigen, wie sich KI bestimmte Gegenstände vorstellt. „Das unten ist recht einfach als Kohlkopf zu erkennen, aber das oben ist ein bisschen schwieriger – es soll einen Seestern darstellen.“ Die Gemälde illustrieren den Versuch der KI, etwas so zu sehen, wie wir Menschen es tun.

Wie menschlich eine KI sein muss

Aber muss sie das überhaupt? KI beherrscht Dinge, die wir Menschen nie können werden, etwa unglaubliche Datenmengen in beeindruckender Geschwindigkeit zu verarbeiten. Warum stellen wir also den Versuch an, sie menschlicher zu machen? Wer ChatGPT nach dem Verbleib der Tasse Kaffee fragt, bekommt natürlich die korrekte Antwort. Weil es mit allen relevanten Daten gefüttert wurde und deshalb die Gesetze der Physik kennt – auch wenn es sie nie erfahren wird.

„Ich glaube nicht, dass eine KI menschlich sein muss. Aber wir hoffen, dass wir diesen Systemen und ihren Vorhersagen mehr Vertrauen schenken können, wenn wir die KI auf transparente Weise an die menschlichen Werte und die Art und Weise, wie Menschen Entscheidungen treffen, anpassen“, sagt Locatello. „Bleiben wir bei einem Sprachmodell“, sagt er. „Etwas, das es lernen soll, ist die Vorhersage des nächsten Wortes. Wenn Sie ‚Frohes neues‘ tippen, ist die Vorhersage einfach: Das Modell wird ‚Jahr‘ vorschlagen, weil das die Wahrscheinlichkeiten in den Daten zeigen.“ Noch besser fände es Locatello, wenn es verstehen würde, warum jemand „Frohes neues Jahr“ schreibt: „Weil es etwas ist, das die Menschen einander zum Jahreswechsel wünschen.“

Etwas Neues und Bedeutsames

Viel Zeit, erzählt Locatello, verbringt er damit, am Campus des ISTA herumzustreifen und Kolleginnen und Kollegen zu fragen, woran sie gerade forschen. „Ich versuche herauszufinden, mit welchen Herausforderungen sie bei ihren Forschungen zu kämpfen haben und wie ich ihnen mit KI-Modellen vielleicht helfen könnte.“

Mein Traum wäre eine wissenschaftliche Entdeckung mithilfe einer kausalen KI.

Francesco Locatello

Denn letzten Endes ist sein Ziel, dass kausale KI doch wieder etwas kann, das Menschen nicht können: „Unser Ziel ist es, zu verstehen, ob zwei Dinge, die miteinander korreliert zu sein scheinen, tatsächlich in einem kausalen Zusammenhang stehen“, erklärt er. Also eine Kausalität dort zu finden, wo wir Menschen sie nicht sehen – auch und vor allem im wissenschaftlichen Kontext. „Mein Traum wäre eine wissenschaftliche Entdeckung mithilfe kausaler KI. Mit meiner Forschung etwas Neues und Bedeutsames über die Welt herauszufinden, das noch niemand zuvor gesehen hat.“

Über diese Serie

Unter dem Titel „Forschungsreisen“ präsentieren wir spannende Forschungsprojekte aus ganz Österreich. Der Pragmaticus war bereits zu Gast beim „Austrian Space Weather Office“ in Graz und bei Markus Hengstschläger, der gerade an Embryoiden forscht. Demnächst erzählt Matthias Seidel im Wiener Naturhistorischen Museum, wie die Lage der Blatthornkäfer in Österreich ist; und Elisabeth Mertl vom OFI erklärt, wie ihre Forschung dabei hilft, Tierversuche zu vermeiden.