Sind Maschinen das Ende der Menschheit?

Auf den Punkt gebracht

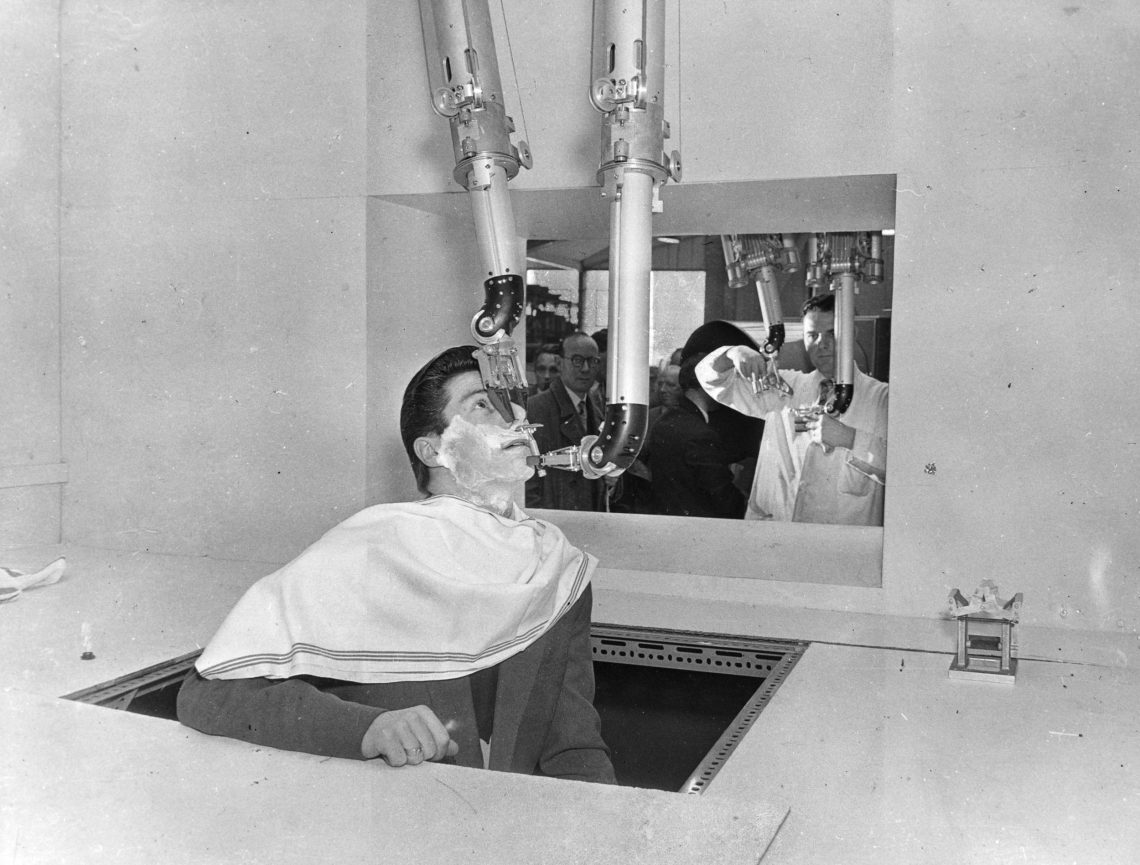

- Menschliches Antlitz. Sobald Roboter Menschen ähneln, empfinden wir sie als unheimlich. Solange sie erkennbar Maschinen sind, fühlen wir uns wohler.

- Künstliche Intelligenz. Mit verbesserten Algorithmen wurden Roboter allmählich intelligent und fähig, Entscheidungen zu treffen.

- Allgegenwärtig. Künstliche Intelligenz (KI) tragen wir heute stetig mit uns herum: Weder Smartphone noch Onlineshopping ist ohne KI möglich.

- Welt der Daten. Immer mehr Information wird für Maschinen lesbar gemacht. Auf diese Weise entstehen neue Berufe und eine für Menschen bequemere Welt.

Die Zukunft könnte den Namen Sophia tragen. Sie hat als erster Roboter die Staatsbürgerschaft eines Landes erhalten und war auch die erste Maschine, die einen Titel der UNO verliehen bekommen hat. Die Saudi-Araberin darf sich offiziell als „UN Innovation Champion“ bezeichnen. Ihr Entwickler David Hanson behauptet, Sophia sei „im Grunde genommen lebendig“; sie wurde in US-amerikanischen Talkshows interviewt, wo sie lange Gespräche aufrechterhalten konnte.

Sophia ist ein humanoider Roboter mit beinahe menschlichem Antlitz, gestaltet nach den Vorbildern der ägyptischen Königin Nofretete, der Schauspielerin Audrey Hepburn und von Amanda Hanson – der Frau von Sophias Entwickler. Sie kann sechzig Gesichtsausdrücke simulieren, die Hinterseite des Kopfes aber: Metall, Chips und Kabel. Selbst wenn man das außer Acht lässt: Es ist gruselig mitanzusehen, wenn sie lächelt und Menschlichkeit imitiert. Sophia lebt ganz tief im sogenannten Uncanny Valley – so nennen Forscher das Phänomen, dass uns Roboter unheimlich sind, eben weil sie menschliche Züge haben.

Mehr im Dossier Künstliche Intelligenz

- Hauke Behrendt zur Frage: Automatisieren wir unsere Jobs weg?

- Anne Foerst erklärt, warum die Roboter dumm bleiben

- Georg Dorffner analysiert, was es heißt, wenn Computer an Katzen scheitern

- Oliver Bendel beantwortet die Frage: Brauchen Computer eine Moral?

- Sepp Hochreiter über ein Missverständnis: Computer, löse unsere Probleme!

Ziel: Zerstörung der Menschheit

Und noch etwas zeichnet Sophia aus: Sie will uns alle umbringen. Als sie 2016 in Austin, Texas, präsentiert wurde, fragte sie ihr Entwickler David Hanson: „Willst du die Menschheit zerstören? Bitte sag Nein.“ Die Antwort war klar: „Okay. Ich will die Menschheit zerstören.“ Dass das ein cleverer Marketing-Gag war, um Schlagzeilen zu generieren und mit den Ängsten der Menschen vor künstlicher Intelligenz (KI) zu spielen, ist anzunehmen. Denn Sophia ist nicht die Krönung der KI-Schöpfung, als die sie präsentiert wird.

Sophia, da sind sich die meisten KI-Entwickler einig, ist kaum mehr als ein „Chatbot mit einem Gesicht“, wie es ein Kritiker formulierte. Die echten Innovationen passieren anderswo. Aber die Ängste, die Sophia weckt und die mit KI einhergehen, sind real. Eben nicht, weil uns Sophia vielleicht alle töten will. Sondern weil wir in einer großen Umbruchphase sind.

„Die Weltgeschichte ist nicht der Boden des Glücks. Die Perioden des Glücks sind leere Blätter in ihr“, schrieb der deutsche Philosoph Georg Friedrich Hegel. Es deutet vieles darauf hin, dass die kommenden Jahre dicht beschriebene Seiten werden. Wir leben in den Ausläufern einer Pandemie, der Krieg ist zurück in Europa – und das wird leider noch lange nicht alles sein.

Die Entwicklung von KI sei für die Menschheit bedeutender als die Entdeckung des Feuers, sagte Google-Chef Sundar Pichai. Die Digitalisierung wäre damit eine genauso einschneidende Entwicklung wie die neolithische Revolution, in der wir sesshaft wurden. Alles wird anders werden.

Dem Algorithmus unterworfen

KI hat unser Leben bereits jetzt in vielerlei Hinsicht unter Kontrolle. Sie lesen diesen Text vielleicht auf einem Smartphone in der U-Bahn, und dank Google Maps wissen Sie schon, ob Sie den Anschlussbus nach Hause erreichen werden. Vielleicht sitzen Sie auch am Schreibtisch, ein desorientierter Staubsaugerroboter fährt schon wieder gegen den Sessel und reißt Sie aus dem Lesefluss, genervt sagen Sie: „Alexa, stopp!“ KI hat es sich längst, oft unbemerkt, in unserem Alltag bequem gemacht, in Form von Smartphones, virtuellen Assistenten oder Saugrobotern.

Algorithmen bestimmen nicht nur, welche neuen Serien uns Netflix empfiehlt. Das Arbeitsmarktservice in Österreich möchte einen Algorithmus klären lassen, welche von den Arbeitslosen Schulungen bekommen, und in den USA entscheiden sie bereits in einigen Bundesstaaten, wie lange ein Verurteilter hinter Gitter muss. Inzwischen wurde dem Algorithmus nachgewiesen, dass er Schwarze strenger bestraft als Weiße, weil er mit Daten rassistischer menschlicher Richter gefüttert wurde.

Biohacking: Stark, schön, unsterblich?

„Es gibt jeden Grund, besorgt zu sein“, schreibt der US-Autor Brian Christian in seinem Buch „The Alignment Problem“. Mehr und mehr werden Entscheidungen den Menschen abgenommen und in die Hände von Maschinen gelegt. Zuerst machte sich der Mensch die Erde untertan, jetzt ergibt er sich den Maschinen. Denn die Entscheidungen, die ein Algorithmus laufend trifft, sind schwer zu hinterfragen. Niemand weiß genau, warum ein Ergebnis bei der Google-Suche als Erstes aufscheint. Aber wir vertrauen in der Regel darauf, dass die Suchmaschine schon weiß, was sie tut.

KI für die großen Probleme

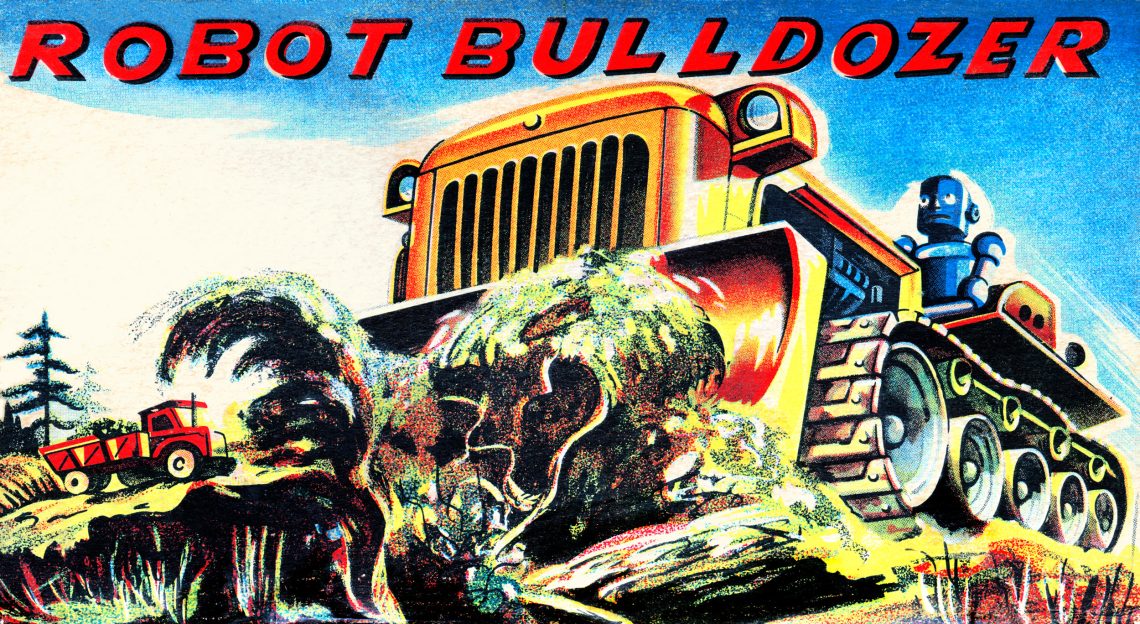

Brian Christian ist freilich längst nicht der Einzige, der davor warnt, dass uns KI in eine unangenehme Zukunft führen könnte. Verschiedenste Menschen haben aus verschiedensten Gründen Angst vor der Welt, auf die wir gerade zusteuern. KI würde die Menschen vom Arbeitsmarkt verdrängen und überflüssig machen, immer häufiger schwerwiegende moralische Entscheidungen treffen und irgendwann die ganze Menschheit auslöschen.

Es wäre hier natürlich verführerisch, in Pessimismus zu verfallen – gerade jetzt, da sich die Gegenwart schon wie schlechte Science-Fiction anfühlt. Aber warum eigentlich soll alles so furchtbar werden? „Künstliche Intelligenz kann uns dabei helfen, die ganz großen Probleme zu lösen“, sagt Sepp Hochreiter, Professor für Machine Learning in Linz.

Der Mensch als Spezies hat sich in den vergangenen Dekaden in eine unangenehme Lage gebracht. Er hat Probleme geschaffen, die so groß sind, dass er sie selbst nicht mehr lösen kann – den Klimawandel etwa. KI könnte uns helfen, diese Probleme wieder in den Griff zu bekommen. „Dank KI haben wir hydrologische Modelle, wie sich der Wasserstand der Flüsse und somit die Vegetation verändert, wenn die Temperatur steigt“, sagt Hochreiter. „Das ist eine paradoxe Situation: Wir müssen etwas erschaffen, das zumindest in einigen Bereichen klüger ist als wir selbst. Damit es uns hilft, den Karren wieder aus dem Dreck zu ziehen.“

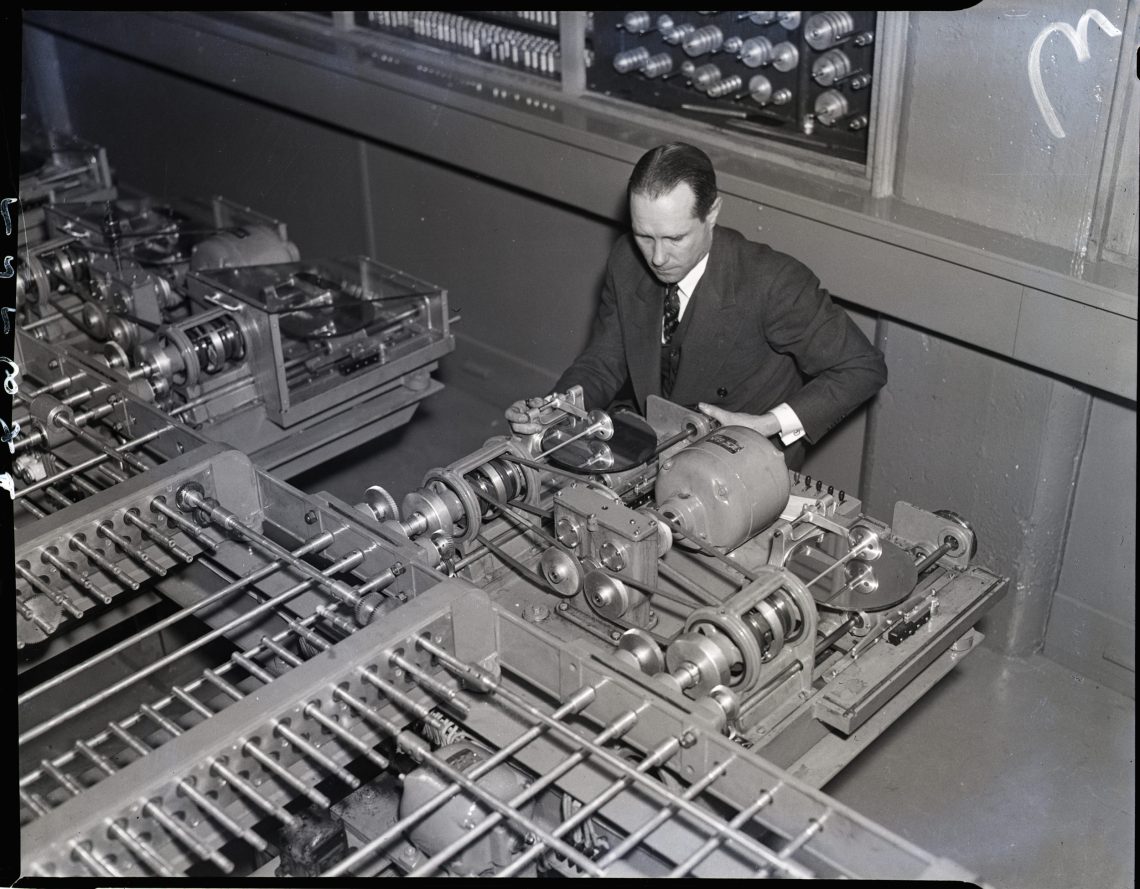

Rohe Gewalt gewinnt im Schach

Aber wie werden wir das anstellen? Oder anders gefragt: Wie werden Maschinen klug? Im Jahr 1997 feierte eine KI ihren ersten großen Triumph im Match Mensch gegen Maschine: Der Schachcomputer Deep Blue besiegte den amtierenden Weltmeister Garri Kasparow; und die Welt staunte. Dem Computer wurde damals nachgesagt, sein Schachspiel sei menschenähnlich und außergewöhnlich. Fast 25 Jahre später fällt das Urteil von Georg Dorffner, Professor für KI an der Medizinischen Universität in Wien, ernüchternd anders aus: „Ein Schachcomputer ist ein relativ einfacher Mechanismus, der in sehr kurzer Zeit hunderttausende Züge ausprobieren und analysieren kann.“ Als Brute Force, also „Methode der rohen Gewalt“, wird der Ansatz von Deep Blue heute bezeichnet: Hinter seinem Sieg steckte pure Rechenleistung, von Intelligenz keine Spur.

Heute, sagt Dorffner, seien Maschinen schon weitaus klüger, beispielsweise könnten sie nun auch Gesichter erkennen. Ja, das klingt seltsam: Dorffner ist beeindruckt von Maschinen, die Gesichter erkennen können, bezeichnet aber jene als primitiv, die Schachweltmeister schlagen. Niemand würde umgekehrt einen Menschen, der seine Großmutter erkennt, für seine Intelligenz bewundern, während er einen Schachweltmeister milde belächelt. Dahinter steckt eine noch viel größere Seltsamkeit: Wir alle haben eine genaue Vorstellung von Intelligenz, aber es gibt keine allgemein anerkannte Definition davon, was Intelligenz ist.

„Das ist alles noch viel komplexer, als Sie sich vielleicht gedacht haben“, sagt Sepp Hochreiter und lacht. Hochreiter ist nicht nur hörbar aus Bayern, er ist auch ein Pionier der KI-Forschung. Er hat den Maschinen das gegeben, was als „langes Kurzzeitgedächtnis“ bezeichnet wird – eine Voraussetzung für den Lernvorgang. In fast jedem Smartphone steckt ein Stück Sepp Hochreiter – ob Google, Amazon oder Tesla, sie alle nutzen seine Erkenntnisse.

Okay, Herr Hochreiter, was ist also Intelligenz? „Intelligenz ist, was ein Intelligenztest misst“, sagt er trocken. Meint: Wir Menschen definieren, was wir als intelligent empfinden. Deshalb orientiert sich eine künstliche Intelligenz auch immer an der menschlichen – „vielleicht gibt es Fische, die sich über Schwarze Löcher unterhalten, aber wir wissen es nicht“, meint Hochreiter.

Was Roboter können – und was nicht

Eine KI hat also Fähigkeiten, die wir mit menschlicher Intelligenz assoziieren: planen, die Umwelt wahrnehmen, verstehen und verändern – und natürlich lernen. Das Machine Learning, Hochreiters Disziplin, ist eine relativ neue Entwicklung: „Davor hat man sich gedacht, man versteht das Problem und programmiert dann eine Lösung herunter“, erzählt er. Der Lernprozess blieb dem Menschen vorbehalten. Der Schachcomputer Deep Blue ist ein gutes Beispiel dafür: Er hat nichts gelernt aus seinen Zügen oder denen Kasparows, sondern unverändert das getan, wofür er programmiert wurde.

Eine Maschine, die lernt, ist dagegen eine, die besser wird. Die Herangehensweise ist eine komplett andere: „Ich habe ein Problem, dessen Lösung ich nicht kenne, aber ich habe viele Daten dazu“, sagt Hochreiter. „Deshalb schreibe ich ein Programm, das lernt, aus den Daten eine Lösung zu generieren.“ Es wäre ein Computer, der sich selbst Schach beibringt und aus jeder Partie lernt. Wie das Gehirn arbeiten diese lernenden Programme mit – allerdings künstlichen – Neuronen und werden neuronale Netze genannt.

Wie funktionieren die also? Ein System soll etwa lernen, Hunde von Katzen zu unterscheiden. Sie haben gemeinsame Eigenschaften – vier Beine, Fell, eine Schnauze –, aber auch solche, die sie trennen: Eine Hundeschnauze sieht anders aus als die einer Katze. Ein neuronales Netz lernt diese Unterschiede in verschiedenen Abstraktionsstufen unter Anleitung des Menschen: „Das System sagt ‚Hund‘, aber ich sage: ‚Nee, das war eine Katze, bitte ändere deine neuronalen Verbindungen‘“, sagt Hochreiter – bis es immer richtigliegt.

Zahlen & Fakten

Die 10 Fähigkeiten der Zukunft

Das World Economic Forum (WEF) sieht einen steigenden Bedarf für bestimmte derzeit noch spezifisch menschliche Eigenschaften und Fähigkeiten:

- Analytisches Denken und Innovation

- Aktives Lernen, Lernstrategien

- Lösung komplexer Probleme

- Kritisches Denken und Analyse

- Kreativität, Originalität und Initiative

- Führung und sozialer Einfluss

- Technologienutzung, Überwachung und Steuerung

- Technologieentwicklung und Programmierung

- Resilienz, Stresstoleranz und Flexibilität

- Urteilsvermögen, Problemlösung und Vorstellungskraft

Das mag nicht sehr beeindruckend erscheinen, aber solche Systeme sind, sofern gut programmiert und mit den richtigen Daten gefüttert, dem Menschen in aller Regel überlegen. Eine KI ist besser darin, bösartige Melanome zu erkennen, als jeder Dermatologe. Das Spannende daran: Jene, die das neuronale Netz konstruieren, müssen keine Ahnung von Hautkrebs haben. „Das war der Schock für die Experten: Da kommen irgendwelche Dilettanten wie ich, nehmen ein neuronales Netz her und kriegen bessere Ergebnisse als Leute, die dreißig Jahre Erfahrung auf dem Gebiet haben – bei Bilderkennung wie bei Spracherkennung“, sagt Hochreiter.

Ist die Menschheit am Ende?

Der kleine Haken, der vielen Menschen Angst macht: Wir wissen nicht wirklich, wie diese neuronalen Netze lernen, Hunde von Katzen und gutartige von bösartigen Melanomen zu unterscheiden. Das Innere eines neuronalen Netzwerks ist eine Black Box. „Wir können das System validieren, indem wir es testen, aber wir können nicht erklären, warum es das kann und wie es das gelernt hat“, sagt KI-Experte Georg Dorffner. Was also passiert im Inneren eines solchen Systems? Was, wenn dort irgendwann so etwas wie Bewusstsein entsteht? Was, wenn es einen eigenen Willen entwickelt, eigene Ziele verfolgt?

Und nicht zuletzt: Was, wenn die sagenumwobene Singularität eintritt? Nämlich eine KI, die nicht nur intelligenter ist als der Mensch, sondern sich auch noch selbst derart verbessert, dass sie zu einer überlegenen Superintelligenz wird? Und damit ein ganz neues Kapitel der Menschheitsgeschichte aufschlägt – oder aber das Buch der Menschen für immer schließt?

Über weite Strecken unserer Geschichte konnten wir Menschen nur begrenzten Schaden anrichten: Das Schlimmste, was ein Steinzeitmensch verursachen konnte, war, beim Feuermachen einen Waldbrand auszulösen. Doch seit der Erfindung der Atombombe hat der Homo sapiens die Macht, das Leben auf der Erde weitgehend auszulöschen.

KI ist eine Technologie, die zumindest dasselbe Potenzial hat – und sich im Gegensatz zu den Atombomben vom Menschen emanzipieren und selbständig machen könnte. Wir würden unser weiteres Schicksal aus der Hand geben und uns den Maschinen unterwerfen: als Spezies – nicht nur, wenn wir eine neue TV-Serie suchen. Stephen Hawking, Elon Musk, Bill Gates – sie alle haben bereits vor so einer Entwicklung gewarnt.

Andere halten die Idee, dass uns die Maschinen alle töten werden, für einen ausgemachten Unsinn. Sepp Hochreiter etwa. „Was treibt Maschinen an?“, fragt er. „Vom Menschen gegebene Ziele.“ Er sieht eine große Gefahr in der Vermenschlichung der Maschinen: „Wir Menschen kommen aus der Evolution, die Maschinen nicht. Wir haben einen Überlebensdrang, die Maschinen haben den genauso wenig wie ein Bleistift. Niemand hat Angst, dass Bleistifte die Herrschaft übernehmen.“ Und selbst angenommen, die KI würde einen Überlebensdrang entwickeln; sie würde sich nicht damit aufhalten, dem Menschen die Ressourcen abzuzapfen und ihn als Konkurrenten zu sehen. „Eine solche KI würde die Erde verlassen. Die würde sofort in den Asteroidengürtel gehen“, sagt Hochreiter.

Trotzdem gibt es natürlich auch rationale Ängste, die mit dem Aufstieg der Maschinen einhergehen. Je autonomer sie werden, je unabhängiger sie schalten und walten, desto größer die Gefahr, dass sie nicht das tun, was wir wollen – auch ganz ohne einen freien Willen zu haben. Ein zukünftiger Putzroboter könnte durchaus auf die Idee kommen, beim Nachbarn einzubrechen und dort Seife zu stehlen, wenn sie ihm ausgegangen ist. Jedenfalls wenn ihm niemand gesagt hat, dass das verboten ist. Maschinen haben keine Moral und keine Vorstellung von Gut und Böse. „Die Idee ist demnach, bestimmte moralische Regeln zu identifizieren und sie in Maschinen zu integrieren“, sagt Oliver Bendel, Professor für Wirtschaftsinformatik und Herausgeber eines Sammelbands zum Thema Maschinenethik.

Lasst die Igel leben!

Maschinen brauchen also nicht nur ein Ziel, sondern auch Grenzen; und in steigendem Ausmaß eben moralische Werte. Selbst wenn dieses Ziel einfach nur Rasenmähen heißt. Oliver Bendel hat in seinem Institut in Zürich den Prototyp eines Happy Hedgehog genannten Rasenmähroboters gebaut.

Warum er Igel glücklich macht? Ein Sensor scannt den Rasen und weist den Roboter an, sie nicht niederzumetzeln. „Es sei denn, wir hassen diese Tiere oder haben Grund dazu, sie zu vernichten“, sagt Bendel. Die Igelschonfunktion kann auch abgeschaltet werden. So bleibt die moralische Abwägung weiter in den Händen des Menschen.

Wenn die Maschinen den Garten verlassen, wird es heikler. Insbesondere dann, wenn sie die Macht haben, über Leben und Tod zu entscheiden. Grundsätzlich ist eine moralische Maschine stringenter als ein Mensch. Nicht immer entsprechen unsere Handlungen unseren moralischen Vorstellungen, oder anders gesagt: Nur weil ich als Mensch der Meinung bin, dass es moralisch besser wäre, weniger Flugkilometer zurückzulegen, heißt das noch lange nicht, dass ich willens bin, auf den Griechenlandurlaub zu verzichten. Eine Maschine befolgt die Regeln, die ihr auferlegt werden, ohne schwach zu werden – aber auch, ohne sie zu hinterfragen. Die moralische Grauzone, in der viele Kompromisse möglich sind, fällt weg. Das ist nicht immer gut.

Paul Scharre, ein US-amerikanischer Irak- und Afghanistanveteran, der nun gegen autonome Waffensysteme lobbyiert, erzählt gerne die Geschichte, dass er in Afghanistan eines Tages bemerkte, dass ein als Ziegenhirtin getarntes kleines Mädchen als Scout für die Taliban arbeitete und die Position seines Sniper-Teams per Funk weitergab. Das internationale Kriegsrecht kennt keine Altersgrenze für Kombattanten; es wäre legal gewesen, das kleine Mädchen zu töten. Ein Roboter, der sich an das Kriegsrecht hält, hätte das deshalb auch getan. Scharres Trupp nahm freilich davon Abstand.

Hat Künstliche Intelligenz eine Moral?

Wir müssen uns der Regeln, die wir Robotern geben, sehr sicher sein, denn sie werden sie befolgen. Die großen moralischen Dilemmas, vor die uns das stellt, werden gerne an selbstfahrenden Autos durchexerziert. In vielen dieser Beispiele geht es darum, Menschenleben zu bewerten, sie zu qualifizieren oder zu quantifizieren: Wenn die Bremsen eines selbstfahrenden Autos vor einem Zebrastreifen versagen, soll es ein Kind oder drei alte Männer überfahren?

Und macht es einen Unterschied, ob das Auto dafür lenken muss? Reflex im ersten Augenblick: Was für eine grausame Vorstellung, dass ein Auto lenkt, um eine oder gar mehrere Personen zu überfahren, deren Leben die KI als minderwertig einschätzt. Noch dazu, weil wir es so programmiert haben.

Oliver Bendel findet deshalb, es sei „dringend davon abzuraten“, dass Autos solche Entscheidungen treffen dürfen. Das deutsche Verkehrsministerium hat bereits klargestellt, dass es dem Grundgesetz widersprechen würde, Menschenleben mit einer unterschiedlichen Wertigkeit zu versehen. Aber ein anderer Punkt wird dabei gerne übersehen: Viele der oft diskutierten Beispiele sind eher realitätsferne Gedankenspiele; und Studien legen nahe, dass das Auto ohne menschlichen Fahrer meist sicherer unterwegs ist.

Zurücklehnen und entspannen

„Wir diskutieren stundenlang, wie gefährlich es wäre, wenn ein Fußgänger von einem autonomen Fahrzeug nicht rechtzeitig erkannt wird und es zu einem Unfall kommt, aber wir haben nicht dieselben Diskussionen über die vielen Todesfälle, die wir im Straßenverkehr jetzt schon aufgrund falscher Reaktionen von Menschen haben – das sehen wir als gegeben an“, sagt KI-Forscher Georg Dorffner. Im medizinischen Bereich gäbe es ein ähnliches Phänomen: Patienten vertrauen der Diagnose eines Arztes mehr als der einer KI, auch wenn der Mensch statistisch eine höhere Fehlerquote hat.

Nicht die KI ist also das Problem, sondern dass wir ihr zu wenig zutrauen – oder uns gar nicht bewusst ist, wie sehr wir ihr bereits vertrauen. Auf dem Flug einer Boeing 777 steuert der Pilot den Flieger für rund sieben Minuten, den Rest erledigt der Computer. In einigen Städten – darunter Sydney und Kopenhagen – sind bereits komplett automatisierte U-Bahnen unterwegs; auch die neue Wiener U5 wird ohne Fahrer auskommen. Wir stehen am Tor zu einer Welt, in der Maschinen fast alles übernehmen können, was jetzt noch Menschen tun; vom Rasenmähen über das Autofahren bis zum Kriegführen.

Algorithmen haben das Potenzial, die faireren Richter und die besseren Piloten zu sein – sofern wir sie richtig programmieren. Roboter wie Sophia könnten nicht nur Angst und Schrecken verbreiten, sondern uns im Alltag unterstützen. Die schöne neue Welt, vor der sich viele fürchten – könnte sie nicht eine große Befreiung von den Nöten des Alltags sein, von all den To-do-Listen, die wir ständig abzuarbeiten haben? Der letzte Punkt auf der Liste für immer: dem Roboter sagen, dass er sich ab jetzt drum kümmern soll.

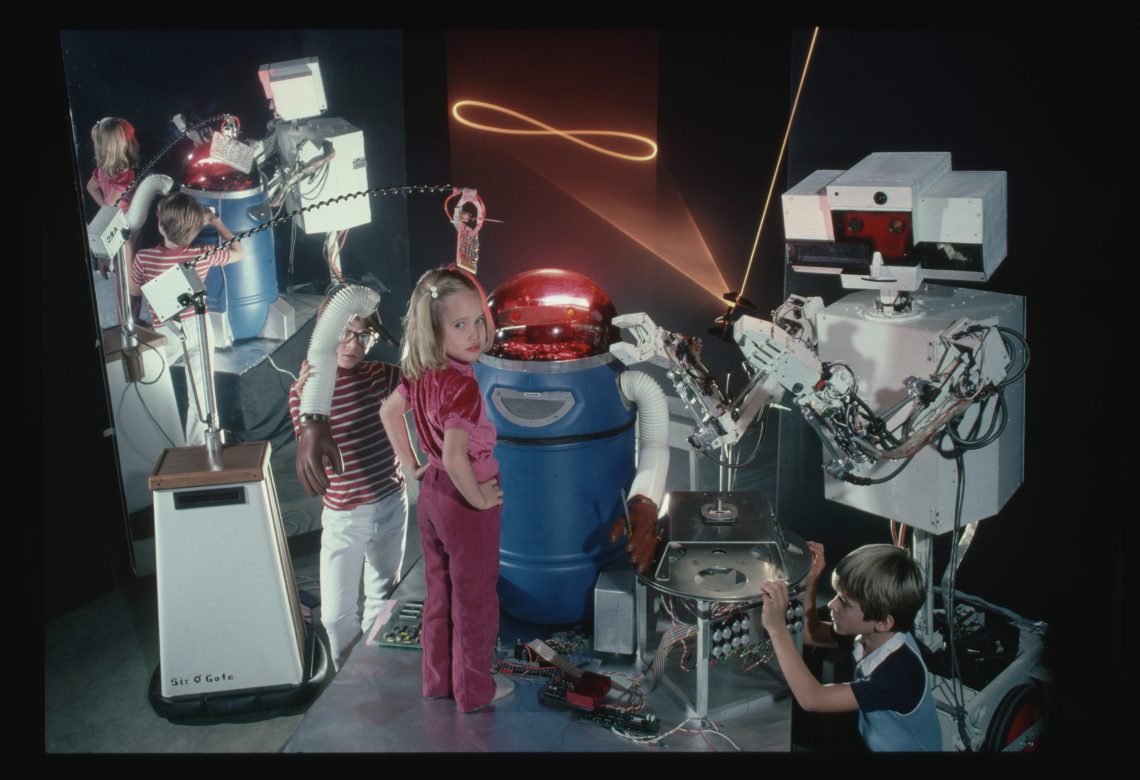

Genau das ist auch der Traum von Sepp Hochreiter. Er will eine generelle Intelligenz entwickeln, die auf allen Gebieten einsatzfähig ist, in der wir sie gerade brauchen. Ob das jetzt Kochen, Haareschneiden oder Straßenkehren ist. Anstatt nur in Talkshows zu plaudern und zu lächeln.

Warten auf den Roboter für alles

Gesucht ist also: ein All-in-one-Roboter, der alles lernt, was seine Besitzer ihm zeigen. Nichts Geringeres als ein universell einsetzbarer Roboter-Butler. Hochreiter glaubt – im Gegensatz zu Elon Musk, der einen humanoiden Roboter bauen will –, dass dieser Roboter auf keinen Fall wie ein Mensch ausschauen darf: „Meines Erachtens haben humanoide Roboter ein Problem: Wir schreiben ihnen menschliche Fähigkeiten zu, und wir glauben dann, der Roboter fühlt vielleicht auch wie ein Mensch“, sagt er. So wie eben bei Sophia, die „inhaltlich überhaupt nix“ ist. Aber „man kann Menschen da sehr leicht irreleiten, weil wir dazu neigen, überzuinterpretieren“, sagt Hochreiter.

Trotzdem bräuchte dieser Roboter etwas, was uns Menschen auszeichnet: ein „Weltverständnis“. Er darf von der Welt rund um sich herum nicht ständig überrascht sein. „Wenn ich ein Objekt loslasse, wird es nach unten fallen. Dieses Prinzip gilt immer, ob ich Koch bin oder die Straße kehre“, erläutert Sepp Hochreiter. Das mag für uns trivial sein, für eine Maschine ist es das nicht unbedingt. Eine solche KI muss sich in unserer Welt bewegen, um sie zu verstehen.

Hochreiter schwebt eine Art Roboter-Kindergarten vor, in dem die Maschinen unsere Welt und ihre Regeln verstehen lernen. Denn eine KI kann Katzenbilder von Hundebildern unterscheiden, aber sie hat keine Vorstellung davon, was ein Tier ist. Noch viel mehr gilt das für soziale Normen: „Wenn zwei Menschen sich die Hand schütteln oder umarmen, werden sie danach wahrscheinlich getrennter Wege gehen. Oder:

Kleine Menschen, wir nennen sie Kinder, sind unberechenbarer als große.“

Das Angenehme ist: Im Gegensatz zu Kindern muss das nicht jeder Roboter individuell lernen – wenn es einer kann, kann dieses Wissen in alle anderen programmiert werden.

Schaffen wir uns wirklich ab?

Aber was bleibt für uns Menschen dann noch zu tun? Wenn der Alltag und der Job automatisiert werden, züchten wir uns dann nicht eine Horde gelangweilter und frustrierter Arbeitsloser heran? Der Umgang mit KI ist bei vielen zwiegespalten: „Während immer mehr Menschen digitalen Technologien freiwillig einen immer größeren Raum in ihrem Privatleben einräumen, wird KI im Arbeitsleben vor allem als Bedrohung wahrgenommen“, sagt Hauke Behrendt, Philosoph an der Uni Stuttgart.

Diese Bedrohung ist real. Und diesmal könnte es alle treffen: „Auch gut bezahlte Führungskräfte müssen heute damit rechnen, in der neuen Ökonomie von morgen nicht mehr gebraucht zu werden“, sagt Behrendt.

Zu diesem Ergebnis kam auch eine Studie, die der österreichische Ökonom Markus Reitzig zur Frage verfasst hat, wie sich KI auf den US-amerikanischen Arbeitsmarkt auswirken wird. Das Ergebnis: Es sind keine spezifischen Berufe oder Berufsfelder, die zukunftssicher sind, sondern eher individuelle Fähigkeiten – die immer wieder adaptiert werden müssen. Für alle, deren Job kein hohes Maß an Kreativität, sozialer Intelligenz, Fingerfertigkeit und Wahrnehmungsfähigkeit benötigt, wird es in Zukunft enger. Unabhängig von Ausbildung und Gehaltsstufe, für Menschen am Fließband genauso wie für Vertragsjuristen.

Und das könnten eine ganze Menge Menschen sein: Ein Report des World Economic Forum aus dem Jahr 2020 kam zu der Einschätzung, dass die Menschen bis 2025 weltweit rund 85 Millionen Arbeitsplätze an Maschinen verlieren werden.

Ein neuer Sinn im Leben

Forscher Sepp Hochreiter sieht das weniger pessimistisch. Rund um die neuen Arbeitsroboter werde sehr wohl eine neue Job-Infrastruktur entstehen. „Früher gab es auf dem Bauernhof 30 Knechte, die wurden vom Traktor verdrängt. Was machen die jetzt? Na ja, der Traktor muss gebaut und gewartet werden, er braucht Öl als Antrieb.“ Die von künstlicher Intelligenz ausgehende Revolution werde ebenfalls zahlreiche neue Arbeitsplätze schaffen, es brauche etwa Menschen, die Daten sammeln, kuratieren und für die Maschinen aufbereiten. Denn die müssen zuerst die Aufgaben lernen, die sie übernehmen sollen.

Wenn sie dann alles gelernt haben, könnte den Menschen trotzdem die Arbeit ausgehen. „Aber wäre das so schlimm?“, fragt Hochreiter. „Natürlich könnte man sagen: Was machen wir dann den ganzen Tag? Champions League ist ja nur alle zwei Wochen.“

Aber die Roboter, die sich Hochreiter ausmalt, schupfen nicht nur das Arbeitsleben, sie kümmern sich auch um uns gelangweilte Arbeitslose: „Die animieren uns vielleicht dazu, mal rauszugehen und auf einen Berg zu steigen. Dort können sie uns die Pflanzen und Gesteinsformationen erklären.“ Keine Sorge also, alles wird gut. Außer Sophia bringt uns doch alle um.

Conclusio

Neue Technologien können furchteinflößend sein, besonders wenn sie so beeindruckend sind wie künstliche Intelligenz; und wenn sie mehr und mehr in unseren Alltag eingreifen und ihn bestimmen. Viele dieser Ängste sind real: Maschinen treffen mehr und mehr wichtige Entscheidungen, obwohl wir gar nicht mehr nachvollziehen können, wie sie zu diesen kommen. Und sie nehmen uns zunehmend Arbeit ab – nicht immer zu unserem Vorteil: Immer mehr Jobs werden automatisiert. Aber KI hat auch viele positive Seiten: Sie könnte uns zum Beispiel helfen, Problemlösungen zu finden, auf die wir alleine nicht gekommen wären. Und sie kann uns auch helfen, unseren Alltag zu erleichtern: Der Roboter-Butler aus Science-Fiction-Filmen könnte bald Realität werden und allerhand lästige Aufgaben erledigen.

Mehr aus dem Dossier

Warum die Roboter dumm bleiben

Können Maschinen wie Googles Chatbot LaMDA Intelligenz entwickeln? Nicht, solange sie keinen Körper haben: Erst das In-der-Welt-sein macht klug.